这是AI翻译的帖子。

选择语言

durumis AI 总结的文章

- 上週三,AI音樂生成服務Udio公開發布。Udio是由前Google DeepMind員工創辦的服務,獲得了音樂人will.i.am和Common的投資,備受期待,評論家對其高水平的AI生成音樂表示了積極的回應。

- 但是,AI是否能真正反映人類的創造力,能否理解人類的情感和文化背景,這些問題也隨之產生。

- 像Udio這樣的AI音樂生成服務,一方面提高了音樂創作的可及性,另一方面也提出了關於人類創造力的本質以及音樂體驗的聯繫的新問題。

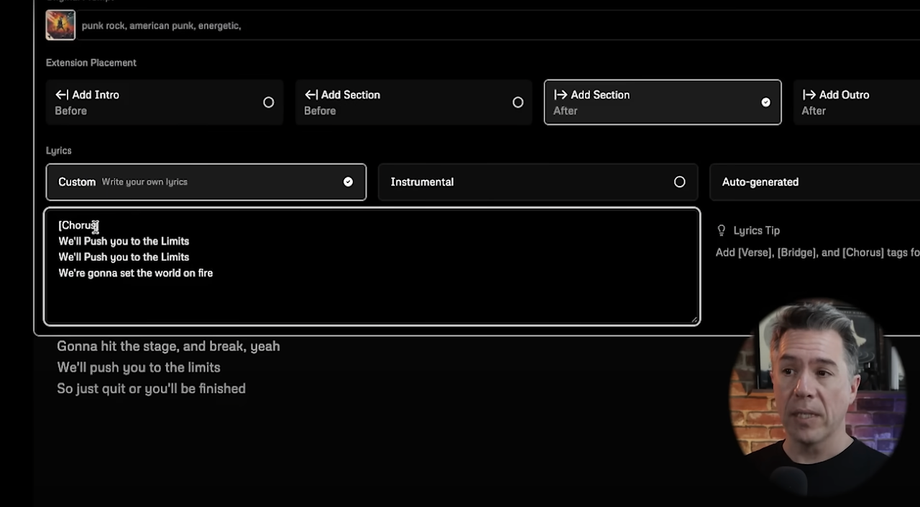

上週三,一款名為 Udio 的 AI 音樂生成服務正式推出,它可以透過文字提示來創作音樂,並添加從人聲到歌詞的元素。經過幾個月的封閉式測試後,這款服務正式亮相,由前 Google DeepMind 員工組成的團隊打造,並且吸引了音樂家 will.i.am 和 Common 等知名投資人和名人,獲得了 1,000 萬美元的種子基金,備受期待。

有趣的是,Udio 團隊提供提前使用服務的體驗者一致認為,他們在現場感、人聲和聲等方面體驗到了高品質的 AI 生成音樂,就如同現場表演一樣。更重要的是,它簡化了音樂製作流程,讓任何人都可以成為作曲家,因此,許多文章都預測這將徹底改變音樂的製作和消費方式。

這反映了 AI 的最新趨勢,即技術正在民主化創意表達,讓更多人可以接觸到藝術創作工具。然而,除了討論這種效率和使用者友善介面帶來的可能性之外,我們也需要思考一些問題。

這些工具能否重現人類創作者在作品中注入的複雜意義和情感深度? 這個問題對於理解 AI 在未來創意產業中的潛力和局限性至關重要。

音樂家 HAINBACH 在他的 YouTube 影片「How Textures Tell a Story」中,透過漫步在寧靜的公園和綠樹成蔭的自然環境中,展現了這些不受控的電子音效如何依據他所處的位置,為聽眾帶來不同的意義和故事體驗。對他來說,Lyra-8 是一款可以根據聲音的感官和文化背景,呈現獨特敘事的樂器。

製造商 Soma 將 Lyra-8 描述為「有機」合成器,因為它採用電容式觸控表面,而不是傳統的鍵盤佈局,可以與使用者的身體特徵互動,例如觸控敏感度、濕度和溫度。這為使用者創造了更親密和身歷其境的體驗,進而加深互動的深度,並使聲音創作體驗變得更加個人化和探索性。這也是一個例子,說明了 AI 尚未能夠令人信服地再現的豐富而多維度的聲音體驗的世界。

當今世界已經充斥著「嗶」聲、「滴」聲和音樂片段。在我們的螢幕和裝置中,我們大多數時間都在沉浸在缺乏深度和背景關聯的聲音中,而此時此刻,又出現了一款新的 AI 音樂生成服務。因此,這個消息既令人興奮,又令人擔憂。從根本上說,Udio 等 AI 技術不僅僅是模仿人類的音樂能力,更應該致力於理解並反映人類創造力背後的複雜情感和文化結構。

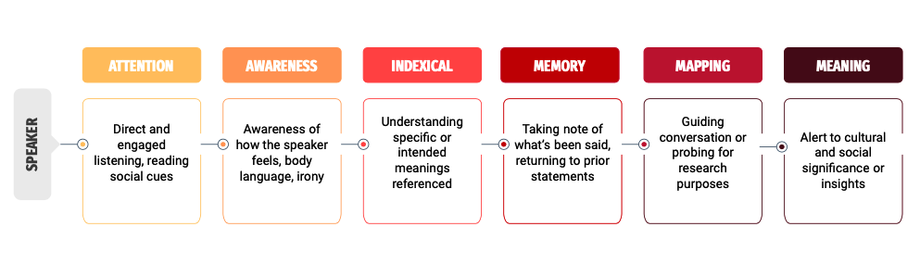

文化人類學家 Michael Powell 在他的論文「摩擦之聲」中強調,為了理解人類的經驗和文化互動要素,「聆聽」是一項非常有效的技術。他的研究結果可以為未來的 AI 音樂生成服務提供一些可供參考的見解。

首先,對話式回饋迴路可能是適當的。 可以借鑑民族誌訪談的重複過程,透過 AI 在回應文字的基本輸入時提出後續問題,或者根據使用者的初始反應調整和改進生成的音樂,來整合系統。

其次,可以嘗試深入分析嵌入在基本文字輸入中的情感語調,以及與之相關的文化質感,以提供個人化的結果。。

第三,就像民族誌學家在調查中不斷深入地獲得更深入的見解一樣,可以考慮將對話歷史作為擴展設計,讓 AI 系統能夠更深入地理解使用者的偏好和文化細微差別。。

像 Udio 這樣的 AI 代表著音樂創作的可及性邁出了重要的一步。然而,它也促使我們思考如何填補創造力的本質和音樂可以提供的微妙的人類經驗之間的聯繫。在技術與傳統、創新與深度之間的這種對話將定義數位時代音樂的未來軌跡。因此,我們不僅需要考慮聲音的製作方式,更需要考慮聲音在我們的社會中如何被感知和被視為有價值。這可能是我們緩慢迎接「人類創作」成為昂貴標籤的時代的最佳方式。

參考資料

![[身心障礙者意識改善專欄]ChatGPT,生成式AI Udio登場!用文字創作30秒音樂](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)