To jest post przetłumaczony przez AI.

Tekstura dźwięku ma znaczenie.

- Język pisania: Koreański

- •

-

Kraj referencyjny: Wszystkie kraje

- •

- TO

Wybierz język

Tekst podsumowany przez sztuczną inteligencję durumis

- W zeszły wtorek oficjalnie uruchomiono usługę tworzenia muzyki AI Udio. Udio to usługa stworzona przez byłych pracowników Google DeepMind, która pozyskała inwestycje od muzyków will.i.am i Common, wzbudzając duże oczekiwania. Recenzenci pozytywnie ocenili wysoką jakość muzyki generowanej przez AI.

- Jednakże pojawia się również pytanie, czy AI będzie w stanie odzwierciedlić ludzką kreatywność, rozumieć ludzkie emocje i kontekst kulturowy.

- Usługi tworzenia muzyki AI, takie jak Udio, zwiększają dostępność do produkcji muzycznej, ale jednocześnie stawiają nowe pytania dotyczące istoty ludzkiej kreatywności i powiązania z muzycznym doświadczeniem.

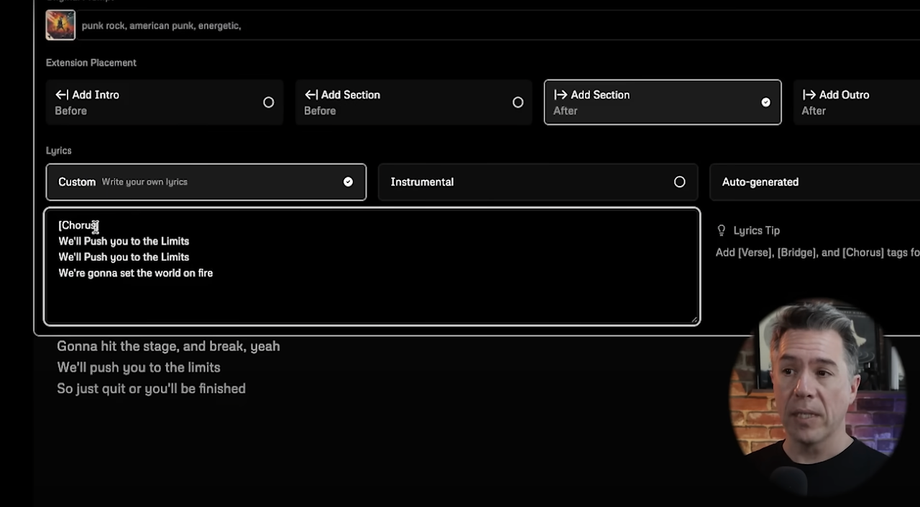

W ubiegły wtorek uruchomiono usługę Udio, która umożliwia tworzenie muzyki przy użyciu podpowiedzi tekstowych, a także dodawanie takich elementów jak wokale i teksty. Usługa, która przeszła kilkumiesięczną fazę prywatnej bety, jest dziełem zespołu byłych pracowników Google DeepMind. Udio zdobyło 10 milionów dolarów finansowania nasiennego od znanych inwestorów i osobistości, takich jak will.i.am i Common, co wzbudziło duże oczekiwania.

Co ciekawe, recenzenci, którzy mieli wczesny dostęp do Udio i korzystali z niego z pomocą zespołu, jednogłośnie stwierdzili, że generowana przez sztuczną inteligencję muzyka osiąga bardzo wysoki poziom, szczególnie w kwestii realizmu w stylu koncertów na żywo i harmonii wokalnych. Co więcej, uproszczenie procesu tworzenia muzyki otwiera możliwość zostania kompozytorem dla każdego, co sugeruje, że w przyszłości możemy spodziewać się rewolucyjnych zmian w sposobie tworzenia i konsumpcji muzyki.

Ten rozwój jest kolejnym przykładem trendu w dziedzinie sztucznej inteligencji, który ma na celu demokratyzację kreatywnej ekspresji, czyniąc narzędzia do tworzenia sztuki dostępne dla większej liczby osób. Jednak oprócz dyskusji o możliwościach płynących z efektywności i przyjaznego dla użytkownika interfejsu, pojawiają się pytania, które należy rozważyć.

Czy takie narzędzia są w stanie odtworzyć złożone znaczenie i głębię emocji, które ludzcy twórcy wkładają w swoje dzieła? To pytanie jest kluczowe dla zrozumienia potencjału i ograniczeń sztucznej inteligencji w przyszłości przemysłu kreatywnego.

Muzyk HAINBACH w swoich treściach na YouTube, How Textures Tell a Story, przenosi nas do spokojnego parku i otoczenia pełnego zieleni, pozwalając nam doświadczyć, jak te niekontrolowane dźwięki elektroniczne są odbierane przez słuchacza w zależności od miejsca, w którym się znajduje, tworząc różne znaczenia i historie. Dla niego Lyra-8 to instrument, który wykorzystuje sensoryczne i kulturowe tło dźwięku, aby stworzyć unikalną narrację.

Producent, Soma, opisuje Lyrę-8 jako syntezator "organiczny", ponieważ nie jest ona oparta na standardowym układzie klawiatury, a na powierzchni dotykowej z pojemnościowym wykrywaniem dotyku, która reaguje na takie czynniki jak wrażliwość dotyku, wilgotność i temperatura, wchodząc w interakcję z cechami fizycznymi użytkownika. To sprawia, że użytkowanie staje się bardziej intymne i angażujące fizycznie, pogłębiając interakcję i czyniąc tworzenie dźwięków bardziej osobistym i odkrywczym. Jest to przykład świata bogatych i wielowymiarowych doświadczeń dźwiękowych, których sztuczna inteligencja jeszcze nie jest w stanie przekonująco odtworzyć.

Świat jest już zalany piknięciami, pikaniem i fragmentami muzyki. Brak głębi i kontekstowego związku w dźwiękach, które nas otaczają na ekranach monitorów i urządzeń, z którymi spędzamy większość czasu, jest już przesycony. W tym kontekście pojawienie się nowej usługi do tworzenia muzyki opartej na sztucznej inteligencji jest zarazem intrygujące i niepokojące. Uważam, że technologie takie jak Udio, próbując naśladować ludzkie zdolności muzyczne, powinny w rzeczywistości dążyć do zrozumienia i odzwierciedlania złożonych emocjonalnych i kulturowych struktur, które wspierają ludzką kreatywność.

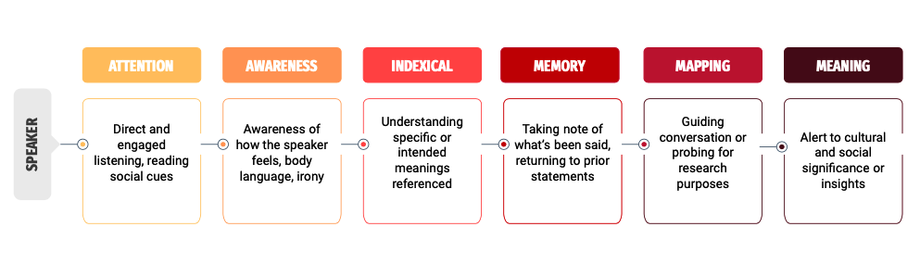

Antropolog kultury, Michael Powell, w swoim artykule The Sound of Friction podkreśla, że "nasłuchiwanie" jest niezwykle skuteczną techniką zrozumienia ludzkich doświadczeń i kulturowych elementów interakcji. Z jego badań można wyciągnąć kilka wniosków, które mogą być pomocne dla firm rozwijających usługi do tworzenia muzyki opartej na sztucznej inteligencji.

Po pierwsze, interaktywna pętla informacji zwrotnej może być odpowiednia. Można rozważyć integrację systemu, który, stosując powtarzalny proces etnograficznych wywiadów, zadawałby sztucznej inteligencji pytania kontynuujące w odpowiedzi na podstawową treść tekstową lub modyfikował i ulepszał tworzoną muzykę, uwzględniając wczesne reakcje użytkownika.

Po drugie, można podjąć próbę dokonania subtelnej analizy, która łączyłaby kulturowe tekstury ze sposobem, w jaki emocjonalny ton i odniesienia są wkomponowane w podstawową treść tekstową.Jest to możliwe, aby dostarczyć spersonalizowane wyniki.

Po trzecie, podobnie jak etnografowie uzyskują coraz głębsze spostrzeżenia w miarę postępu badań, można również rozważyć rozszerzenie konstrukcji roli historii rozmowy, aby system sztucznej inteligencji mógł rozwijać zrozumienie preferencji użytkownika i niuansów kulturowych.To może się stać.

Sztuczna inteligencja, taka jak Udio, to ważny krok w kierunku zwiększenia dostępności do tworzenia muzyki. Jednakże, stawia ona również pytania o to, jak wypełnić lukę między naturą kreatywności a łącznością z subtelnymi doświadczeniami ludzkimi, które może zapewnić muzyka. Ta rozmowa między technologią a tradycją, innowacyjnością a głębią zdefiniuje przyszły tor rozwoju muzyki w erze cyfrowej. Dlatego ważne jest, aby rozważyć nie tylko sposób tworzenia dźwięku, ale także to, jak dźwięk jest postrzegany i ceniony w naszym społeczeństwie. To może nieco spowolnić nadejście czasów, gdy "twórczość ludzka" stanie się luksusową etykietą.

Źródła

![[Kolumna dotycząca świadomości niepełnosprawności] Chat GPT, pojawia się generatywna sztuczna inteligencja Udio! Muzyka w 30 sekund z tekstu](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)