Dit is een door AI vertaalde post.

De textuur van geluid is belangrijk.

- Taal van de tekst: Koreaans

- •

-

Referentieland: Alle landen

- •

- Informatietechnologie

Selecteer taal

Samengevat door durumis AI

- Afgelopen woensdag werd de AI-muziekgeneratiedienst Udio officieel gelanceerd. Udio is een dienst die is gemaakt door voormalige medewerkers van Google DeepMind, en heeft investeringen van muzikanten will.i.am en Common ontvangen, wat de verwachtingen hoog heeft gelegd. Recensenten reageerden positief op de hoge kwaliteit van de AI-gegenereerde muziek.

- Er wordt echter ook de vraag gesteld of AI de creativiteit van mensen op een bevredigende manier kan reflecteren, of het in staat is om menselijke emoties en culturele contexten te begrijpen.

- AI-muziekgeneratiediensten zoals Udio verhogen de toegankelijkheid van muziekproductie, maar werpen tegelijkertijd nieuwe vragen op over de essentie van menselijke creativiteit en de verbinding met muzikale ervaringen.

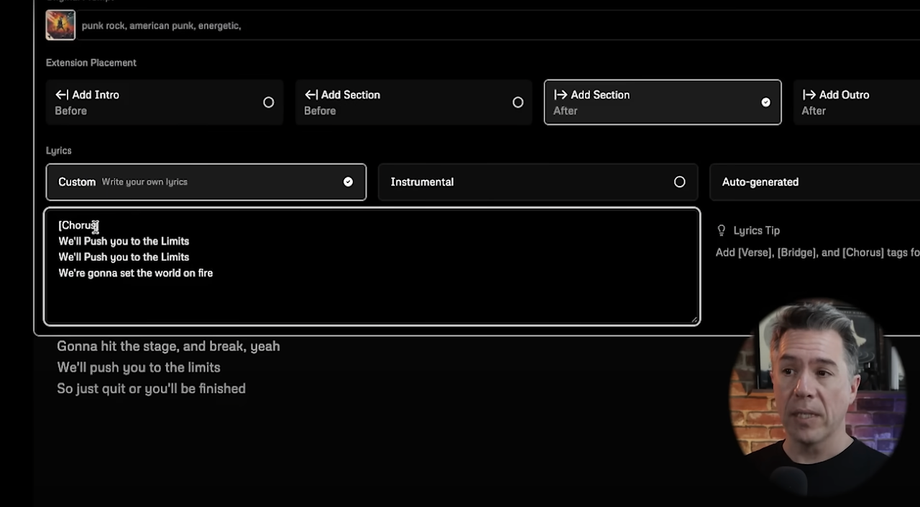

Afgelopen woensdag werd Udio gelanceerd, een AI-muziekservice waarmee je met behulp van tekstprompts muziek kunt maken en zelfs elementen zoals zang en songteksten kunt toevoegen. De service, die na maandenlange gesloten bètatests werd uitgebracht, is het resultaat van een team van voormalige Google DeepMind-medewerkers. Het heeft $10 miljoen aan seedfinanciering opgehaald van gerenommeerde investeerders en beroemdheden, waaronder muzikant will.i.am en Common, waardoor er veel verwachtingen waren.

Interessant is dat reviewers die Udio met ondersteuning van het team van tevoren hebben uitgeprobeerd, allemaal consequent melding maakten van AI-gegenereerde muziek van zeer hoge kwaliteit, met een realistische, live-achtige sfeer, vocale harmonieën en meer. Bovendien suggereert het de mogelijkheid om voor iedereen componist te worden door het vereenvoudigen van het muziekproductieproces, waardoor er in artikelen te vinden is dat er een revolutionaire verandering te verwachten is in de manier waarop muziek wordt geproduceerd en geconsumeerd.

Deze ontwikkeling is een ander voorbeeld van de AI-trend om creatieve expressie te democratiseren, waardoor meer mensen toegang krijgen tot tools voor artistieke creatie. Maar naast de discussie over de mogelijkheden die voortvloeien uit deze efficiëntie en gebruiksvriendelijke interfaces, zijn er ook vragen die we moeten overwegen.

Kunnen deze toolsde complexe betekenis en emotionele diepte weerspiegelen die menselijke makers in hun werk stoppen? Deze vraag is cruciaal om de potentiële kracht en beperkingen van AI in de creatieve industrie van de toekomst te begrijpen.

Muzikant HAINBACH laat in de YouTube-content How Textures Tell a Story zien hoe hij door een rustig park beweegt, omringd door gras en bomen, en laat zien hoe deze oncontroleerbare elektronische geluiden voor de luisteraar verschillende betekenissen en verhalen opleveren, afhankelijk van de locatie waar hij zich bevindt. Voor hem is de Lyra-8 een instrument dat een uniek verhaal creëert dat past bij de sensorische en culturele context van de geluiden.

De fabrikant Soma omschrijft de Lyra-8 als een 'organische' synthesizer, omdat deze geen standaard toetsenbordlayout volgt, maar een capacitief touchscreen heeft dat reageert op fysieke eigenschappen van de gebruiker, zoals aanraakgevoeligheid, vochtigheid en temperatuur. Dit creëert een meer intieme en fysiek meeslepende ervaring voor de gebruiker, waardoor de diepte van de interactie wordt vergroot en het proces van het creëren van geluid zeer persoonlijk en verkennend wordt. Dit is een voorbeeld van een rijke en meerdimensionale geluidservaring die AI nog niet overtuigend heeft kunnen repliceren.

De wereld zit al vol met piepjes, gezoem en muzieksnippets. We brengen de meeste tijd door in een verzadigde toestand op de schermen van onze monitoren en apparaten, gevuld met geluid dat weinig diepte of contextuele relevantie heeft. Het nieuws over de release van nog een nieuwe AI-muziekservice is daarom intrigerend en tegelijkertijd verontrustend. In essentie moet AI-technologie zoals Udio niet alleen menselijke muzikale vaardigheden nabootsen, maar ook streven naar het begrijpen en weerspiegelen van de complexe emotionele en culturele structuren die menselijke creativiteit ondersteunen.

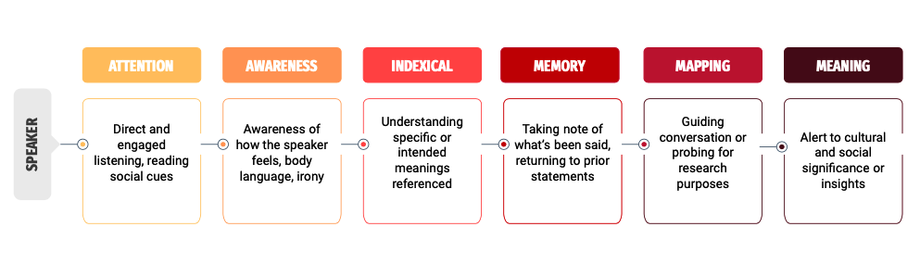

De cultureel antropoloog Michael Powell benadrukt in zijn artikel The Sound of Friction dat 'luisteren' een zeer effectieve techniek is om menselijke ervaring en culturele interactie te begrijpen. Zijn onderzoek levert de volgende inzichten op die bedrijven die AI-gegenereerde muziekservices ontwikkelen, in overweging moeten nemen:

Ten eerste kan een interactieve feedbacklus geschikt zijn. We kunnen de iteratieve processen van etnografisch interviewen toepassen om te overwegen om AI te laten reageren met follow-upvragen op de basistekst-input, of om een systeem te integreren dat muziek verfijnt en aanpast op basis van de initiële respons van de gebruiker.

Ten tweede kunnen we eensubtiele analyse overwegen die rekening houdt met de emotionele toon en de culturele nuances die vervat zitten in de basistekstinput, om gepersonaliseerde resultaten te bieden.

Ten derde, net zoals etnografen steeds meer inzicht krijgen naarmate het onderzoek vordert, kan het AI-systeemde gebruikersvoorkeuren en het begrip van culturele nuances verbreden door een uitgebreid ontwerp van de gespreksgeschiedenis.

AI zoals Udio is een belangrijke stap voorwaarts in het verhogen van de toegankelijkheid van het creëren van muziek. Het roept echter ook vragen op over hoe we de kern van creativiteit en de verbinding met de subtiele menselijke ervaringen die muziek kan bieden, kunnen aanvullen. Dit gesprek tussen technologie en traditie, innovatie en diepte, zal de toekomstige koers van muziek in het digitale tijdperk bepalen. Daarom is het overwegen van de manier waarop geluid wordt gecreëerd, maar ook hoe het wordt waargenomen en gewaardeerd in onze samenleving, misschien de beste manier om een tijdperk waarin 'menselijke creaties' een premium label worden, iets te vertragen.

Referenties

![[Column over inclusie van mensen met een handicap] Chat GPT, generatieve AI Udio (Udio) is hier! Muziek maken in 30 seconden met tekst](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)