Questo è un post tradotto da IA.

La consistenza del suono è importante.

- Lingua di scrittura: Coreana

- •

-

Paese di riferimento: Tutti i paesi

- •

- Tecnologia dell'informazione

Seleziona la lingua

Testo riassunto dall'intelligenza artificiale durumis

- Mercoledì scorso, il servizio di generazione musicale AI Udio è stato rilasciato pubblicamente. Udio è un servizio creato da ex dipendenti di Google DeepMind e ha attirato molta attenzione dopo aver ricevuto investimenti da musicisti will.i.am e Common, e i revisori hanno espresso reazioni positive sulla musica AI di alta qualità.

- Tuttavia, si pone anche la domanda se l'IA possa veramente riflettere la creatività umana, se possa comprendere le emozioni e il contesto culturale umani.

- Servizi di generazione musicale AI come Udio stanno aumentando l'accessibilità alla creazione musicale, ma allo stesso tempo pongono nuove domande sulla natura della creatività umana e sulla connessione con l'esperienza musicale.

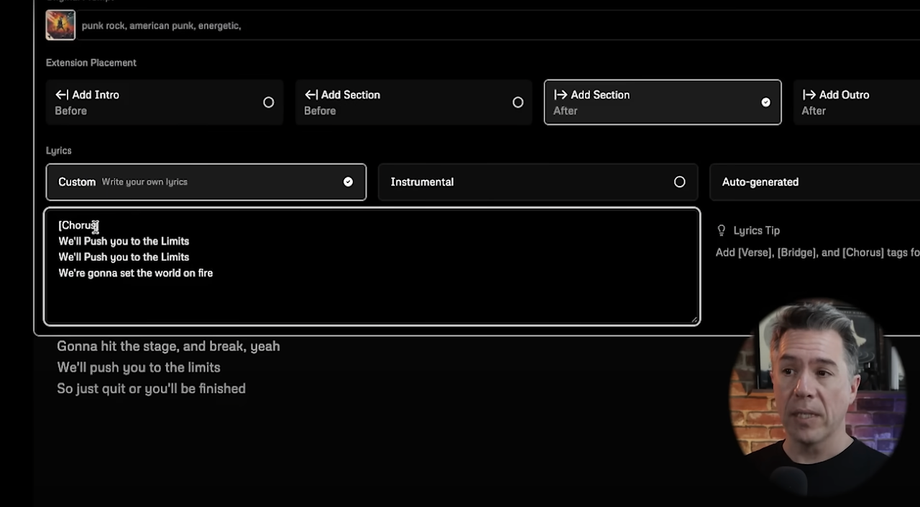

Mercoledì scorso è stato lanciato Udio, un servizio di generazione musicale AI che consente di creare musica tramite prompt di testo e di aggiungere elementi come la voce e i testi. Il servizio, che è stato in beta chiusa per diversi mesi, è il risultato del lavoro di un team di ex dipendenti di Google DeepMind e ha attirato l'attenzione di investitori e celebrità di spicco come will.i.am e Common, che hanno finanziato la sua fase iniziale con 10 milioni di dollari.

Un aspetto interessante è che i revisori che hanno avuto accesso anticipato al servizio con il supporto del team di Udio hanno espresso unanimemente la loro esperienza con la musica generata dall'IA di altissimo livello, caratterizzata da un'atmosfera simile a quella di un concerto dal vivo e da armonie vocali. Inoltre, semplificando la creazione musicale, Udio offre la possibilità a chiunque di diventare un compositore, aprendo la strada a cambiamenti rivoluzionari nel modo in cui la musica viene creata e consumata in futuro, come dimostrano diversi articoli.

Questo progresso rappresenta un altro esempio di come la tecnologia sta democratizzando l'espressione creativa, consentendo a un numero sempre maggiore di persone di accedere agli strumenti di creazione artistica. Tuttavia, oltre a discutere le possibilità offerte da questa efficienza e da un'interfaccia intuitiva, è necessario affrontare anche alcune domande.

Questi strumenti sono in grado di riprodurre la complessa profondità di significato ed emozione che i creatori umani infondono nelle loro opere? Questa domanda è fondamentale per comprendere il potenziale e i limiti dell'IA nel futuro dell'industria creativa.

Il musicista HAINBACH, nel suo contenuto di YouTube "How Textures Tell a Story", guida lo spettatore attraverso un tranquillo parco, ricco di erba e alberi, e dimostra come i suoni elettronici incontrollati che emette, a seconda del luogo in cui si trova, si traducono in esperienze diverse per l'ascoltatore, trasmettendo significati e storie uniche. Per lui, la Lyra-8 è uno strumento che integra la sua sensibilità sonora e il suo contesto culturale, dando vita a una narrazione distintiva.

Soma, il produttore, descrive la Lyra-8 come un sintetizzatore "organico", perché, anziché seguire il tradizionale layout della tastiera, presenta una superficie tattile capacitiva che reagisce alle caratteristiche fisiche dell'utente, come la sensibilità al tocco, l'umidità e la temperatura. Ciò consente di creare un ambiente più intimo e immersivo a livello fisico, intensificando la profondità dell'interazione e rendendo l'esperienza di creazione sonora estremamente personale ed esplorativa. Questo è un esempio di come il mondo delle esperienze sonore, ricco e multidimensionale, sia ancora una realtà che l'IA non è in grado di replicare in modo convincente.

Il mondo è già pieno di suoni "bip, boo" e frammenti musicali. Siamo costantemente immersi in una saturazione di suoni privi di profondità o di connessioni contestuali, all'interno degli schermi dei monitor e dei dispositivi che dominano la maggior parte del nostro tempo. In questo contesto, la notizia del lancio di un altro servizio di generazione musicale basato sull'IA è allo stesso tempo intrigante e preoccupante. In definitiva, crediamo che tecnologie come Udio, basate sull'intelligenza artificiale, dovrebbero puntare non solo a imitare le capacità musicali umane, ma anche a comprendere e riflettere le complesse strutture emotive e culturali che sostengono la creatività umana.

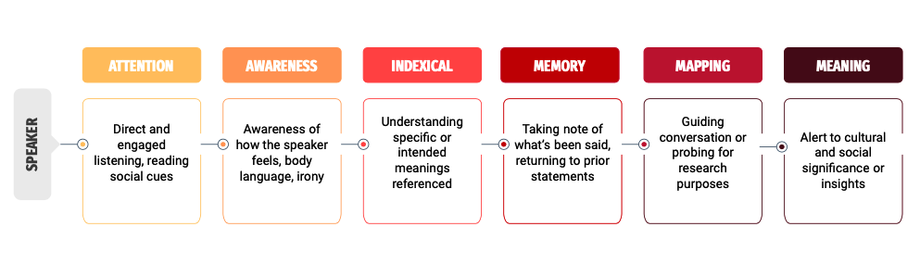

Nell'articolo "The Sound of Friction", l'antropologo culturale Michael Powell ha sottolineato l'importanza dell' "ascolto" come tecnica efficace per comprendere le esperienze e le interazioni culturali degli individui. La sua ricerca offre alcuni spunti di riflessione per le aziende che si occupano di sviluppare i futuri servizi di generazione musicale basati sull'IA.

In primo luogo, un loop di feedback interattivo potrebbe essere appropriato. Applicando il processo iterativo delle interviste etnografiche, è possibile considerare l'integrazione di un sistema in cui l'IA pone domande di follow-up in risposta all'input di testo di base o perfeziona e adatta la musica generata in base alla risposta iniziale dell'utente.

In secondo luogo, è possibile analizzare con delicatezza il tono emotivo e la trama culturale correlata al testo di input di basee cercare di fornire un output personalizzato.

In terzo luogo, proprio come gli antropologi etnografici approfondiscono le loro intuizioni man mano che la ricerca procede, è possibile considerare la progettazione di un'estensione del ruolo della cronologia delle conversazioniin modo che il sistema di intelligenza artificiale possa espandere la sua comprensione delle preferenze dell'utente e delle sfumature culturali.

L'IA come Udio rappresenta un passo avanti significativo per migliorare l'accessibilità alla creazione musicale. Tuttavia, solleva anche interrogativi su come colmare il divario tra la natura della creatività e il legame con le esperienze umane sottili che la musica può offrire. Questo dialogo tra tecnologia e tradizione, innovazione e profondità, definirà la traiettoria futura della musica nell'era digitale. Pertanto, è fondamentale considerare non solo il modo in cui vengono creati i suoni, ma anche come vengono percepiti e apprezzati nella nostra società. Questa riflessione potrebbe rallentare, almeno in parte, l'arrivo di un'epoca in cui le "creazioni umane" diventeranno un'etichetta di lusso.

Riferimenti

![[Colonna di sensibilizzazione sulla disabilità] Chat GPT, l'intelligenza artificiale generativa Udio fa la sua apparizione! Musica di 30 secondi creata con testo](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)