Ceci est un post traduit par IA.

La texture du son est importante.

- Langue de rédaction : Coréen

- •

-

Pays de référence : Tous les pays

- •

- Technologies de l'information

Choisir la langue

Texte résumé par l'IA durumis

- Mercredi dernier, le service de génération de musique par IA Udio a été lancé publiquement. Udio est un service créé par d'anciens employés de Google DeepMind, qui a suscité un grand intérêt en obtenant des investissements des musiciens will.i.am et Common. Les critiques ont réagi positivement à la haute qualité de la musique générée par l'IA.

- Cependant, la question se pose de savoir si l'IA peut réellement refléter la créativité humaine, comprendre les émotions humaines et les contexte culturel.

- Les services de génération de musique par IA comme Udio augmentent l'accessibilité à la production musicale tout en posant de nouvelles questions sur la nature de la créativité humaine et le lien avec l'expérience musicale.

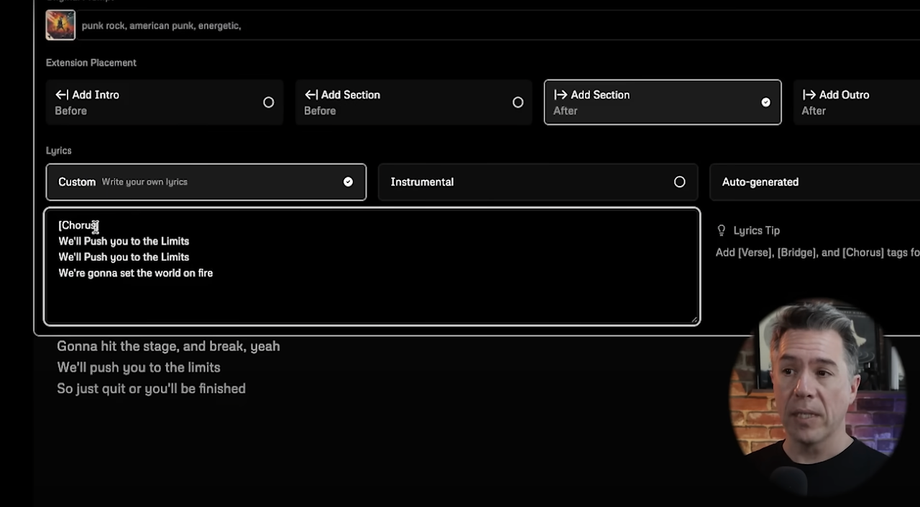

Mercredi dernier, Udio, un service de génération musicale par IA qui permet de créer de la musique à partir d'invites textuelles et d'ajouter des éléments comme les voix et les paroles, a été lancé officiellement. Après plusieurs mois de bêta fermée, le service, qui est le fruit du travail d'une équipe composée d'anciens employés de DeepMind de Google, a suscité beaucoup d'attente en obtenant un financement de démarrage de 10 millions de dollars de la part d'investisseurs de renom et de célébrités, notamment le musicien will.i.am et Common.

Ce qui est intéressant, c'est que les testeurs qui ont eu la chance d'utiliser le service avant sa sortie, avec le soutien de l'équipe d'Udio, ont tous convenu qu'ils avaient vécu une expérience musicale générée par l'IA de très haut niveau, notamment en termes d'immersion, comme si on assistait à un concert live, et d'harmonie vocale. De plus, on peut facilement trouver des articles qui suggèrent que la simplification de la création musicale, qui permet à tout le monde de devenir compositeur, pourrait révolutionner la création et la consommation musicales à l'avenir.

Cette évolution est un autre exemple de la tendance actuelle en matière d'IA qui vise à démocratiser l'expression créative et à rendre les outils de création artistique accessibles à un plus large public. Cependant, au-delà des discussions sur le potentiel de cette efficacité et de cette interface conviviale, il y a des questions à prendre en compte.

Ces outils peuvent-ils reproduire la complexité des significations et la profondeur des émotions qu'un créateur humain insuffle à son œuvre ? Cette question est essentielle pour comprendre le potentiel et les limites de l'IA dans l'industrie de la création à venir.

Le musicien HAINBACH, dans sa vidéo Youtube intitulée How Textures Tell a Story, nous emmène dans un parc tranquille, au milieu de la nature, avec de l'herbe et des arbres, et nous permet de découvrir comment ces sons électroniques incontrôlables prennent des significations et des histoires différentes pour l'auditeur en fonction de l'endroit où il se trouve. Pour lui, le Lyra-8 est un instrument qui permet de créer une narration unique en fonction du contexte sensoriel et culturel du son.

Le fabricant Soma qualifie le Lyra-8 de synthétiseur "organique" car il se caractérise par une surface tactile capacitive qui répond aux caractéristiques physiques de l'utilisateur, comme la sensibilité au toucher, l'humidité et la température, plutôt que de suivre la disposition traditionnelle du clavier. Cela crée un environnement plus intime et plus immersif sur le plan physique, ce qui renforce la profondeur de l'interaction et rend l'expérience de création sonore très personnelle et exploratoire. Et c'est là qu'on trouve un exemple d'un monde d'expériences sonores riches et multidimensionnelles que l'IA n'a pas encore réussi à reproduire de manière convaincante.

Le monde est déjà saturé de bips, de boops, d'extraits musicaux. Nous passons la plupart de notre temps dans des écrans d'ordinateurs ou d'appareils qui sont saturés de sons manquant de profondeur ou de liens contextuels. L'arrivée d'un nouveau service de génération musicale par IA est donc à la fois excitante et inquiétante. Fondamentalement, je pense que les technologies d'IA comme Udio doivent non seulement imiter les capacités musicales humaines, mais aussi comprendre et refléter les structures émotionnelles et culturelles complexes qui sous-tendent la créativité humaine.

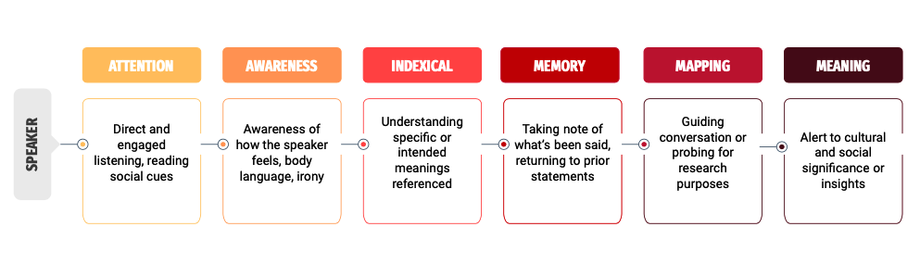

L'anthropologue culturel Michael Powell, dans son article The Sound of Friction, a souligné l'importance de "l'écoute" comme technique efficace pour comprendre les expériences humaines et les éléments d'interaction culturelle. Voici quelques idées tirées de ses recherches que les entreprises qui développent des services de génération musicale par IA pourraient prendre en compte à l'avenir.

Premièrement, une boucle de feedback interactive peut être appropriée. En appliquant le processus itératif des interviews ethnographiques, il est possible d'envisager l'intégration d'un système dans lequel l'IA pose des questions de suivi en réponse à l'entrée de texte de base, ou affinait et ajustait la musique générée en fonction des réactions initiales de l'utilisateur.

Deuxièmement, il est possible de tenter d'apporter une fourniture de résultats personnalisés en tenant compte de l'analyse subtile des nuances émotionnelles ou de la texture culturelle liées au texte d'entrée de base.

Troisièmement, tout comme un ethnologue approfondit ses connaissances au fur et à mesure que l'enquête progresse, il est possible de concevoir une extension de la fonction d'historique des conversations pour que le système d'IA puisse élargir sa compréhension des préférences de l'utilisateur et des nuances culturelles.

L'IA comme Udio représente une avancée importante pour rendre la création musicale plus accessible. Cependant, elle nous incite également à réfléchir à la façon de combler le fossé entre la nature de la créativité et le lien avec les expériences humaines subtiles que la musique peut offrir. Ce dialogue entre la technologie et la tradition, l'innovation et la profondeur, définira la trajectoire future de la musique à l'ère numérique. C'est pourquoi il est important de réfléchir non seulement à la façon dont le son est créé, mais aussi à la façon dont il est perçu et valorisé dans notre société, ce qui pourrait nous permettre de retarder un peu l'arrivée d'une époque où les "œuvres humaines" seront considérées comme des labels de luxe.

Références

![[Colonne d'opinion sur la sensibilisation au handicap] Chat GPT, apparition de l'IA générative Udio ! Musique en 30 secondes à partir de texte](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)