Dies ist ein von KI übersetzter Beitrag.

Die Klangtextur ist wichtig.

- Schreibsprache: Koreanisch

- •

-

Referenzland: Alle Länder

- •

- IT

Sprache auswählen

Von durumis AI zusammengefasster Text

- Am vergangenen Mittwoch wurde der KI-Musikgenerierungsdienst Udio offiziell veröffentlicht. Udio wurde von ehemaligen Google DeepMind-Mitarbeitern entwickelt und hat Investitionen von den Musikern will.i.am und Common erhalten, was große Erwartungen weckt. Rezensenten reagierten positiv auf die hohe Qualität der KI-generierten Musik.

- Es stellt sich jedoch auch die Frage, ob KI die menschliche Kreativität wirklich widerspiegeln kann und ob sie menschliche Emotionen und kulturelle Kontexte verstehen kann.

- KI-Musikgenerierungsdienste wie Udio erhöhen die Zugänglichkeit der Musikproduktion, werfen aber gleichzeitig neue Fragen zur Natur der menschlichen Kreativität und zur Verbindung von musikalischer Erfahrung auf.

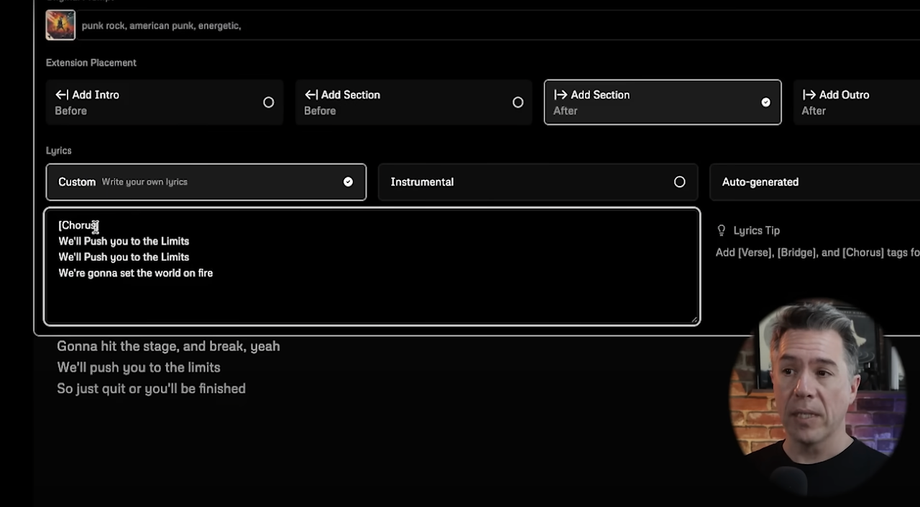

Letzte Woche wurde Udio, ein KI-Musikgenerierungsdienst, der es ermöglicht, Musik über Text-Prompts zu erstellen und sogar Elemente wie Gesang und Texte hinzuzufügen, offiziell veröffentlicht. Der Dienst, der sich über mehrere Monate in einer geschlossenen Betaphase befand, ist das Ergebnis eines Teams ehemaliger Google DeepMind-Mitarbeiter und hat bereits vor seinem Start Aufsehen erregt, da er eine Seed-Finanzierung von 10 Millionen US-Dollar von prominenten Investoren und Persönlichkeiten wie will.i.am und Common erhalten hat.

Interessanterweise haben Rezensenten, die Udio im Rahmen eines Early-Access-Programms genutzt haben, übereinstimmend von der hohen Qualität der KI-generierten Musik berichtet, insbesondere in Bezug auf die Authentizität von Live-Auftritten und Gesangsharmonien. Darüber hinaus wird die Vereinfachung der Musikproduktion von Udio als potenzielles Werkzeug für jedermann, um Komponist zu werden, gepriesen, was darauf hindeutet, dass die Art und Weise, wie Musik in Zukunft produziert und konsumiert wird, revolutioniert werden könnte.

Diese Entwicklung ist ein weiteres Beispiel für den Trend, dass KI die kreative Ausdrucksfähigkeit demokratisiert und mehr Menschen Zugang zu künstlerischen Werkzeugen verschafft. Doch neben der Diskussion über die Möglichkeiten, die sich aus dieser Effizienz und den benutzerfreundlichen Schnittstellen ergeben, stellt sich auch eine wichtige Frage.

Können diese Werkzeuge die komplexe Bedeutung und die emotionale Tiefe wiedergeben, die menschliche Schöpfer in ihre Werke einbringen?Diese Frage ist entscheidend, um das Potenzial und die Grenzen der KI in der zukünftigen Kreativwirtschaft zu verstehen.

Der Musiker HAINBACH demonstriert in seinem YouTube-Video „How Textures Tell a Story“, wie diese unkontrollierbaren elektronischen Klänge je nach Standort des Hörers in einem ruhigen Park und inmitten von Pflanzen und Bäumen verschiedene Bedeutungen und Geschichten vermitteln. Für ihn ist der Lyra-8 ein Instrument, mit dem er zu den sinnlichen und kulturellen Kontexten des Klangs passende, einzigartige Narrative erstellen kann.

Soma, der Hersteller des Instruments, bezeichnet den Lyra-8 als „organischen“ Synthesizer, da er auf einer kapazitiven Touch-Oberfläche basiert, die nicht dem herkömmlichen Keyboard-Layout folgt, sondern auf Berührungsempfindlichkeit, Feuchtigkeit, Temperatur und andere körperliche Eigenschaften des Benutzers reagiert. Dadurch wird eine intimere und körperlichere Umgebung geschaffen, die die Interaktion vertieft und die Klangproduktion zu einem sehr persönlichen und erforschenden Erlebnis macht. Dies ist ein Beispiel für die Welt der reichen, multidimensionalen Klangwelten, die KI noch nicht überzeugend nachbilden kann.

Die Welt ist bereits überflutet mit Piep- und Pieptönen sowie Musik-Schnipseln. Wir verbringen die meiste Zeit vor Bildschirmen von Monitoren und Geräten, die mit Sound gesättigt sind, der an Tiefe oder Kontext fehlt. In dieser Umgebung ist die Nachricht von der Einführung eines weiteren KI-Musikgenerierungsdienstes sowohl aufregend als auch besorgniserregend. Im Wesentlichen sollte sich das Ziel von KI-Technologien wie Udio nicht nur darauf beschränken, die musikalischen Fähigkeiten von Menschen zu imitieren, sondern auch darauf, die komplexen emotionalen und kulturellen Strukturen zu verstehen, die die menschliche Kreativität unterstützen, und diese widerzuspiegeln.

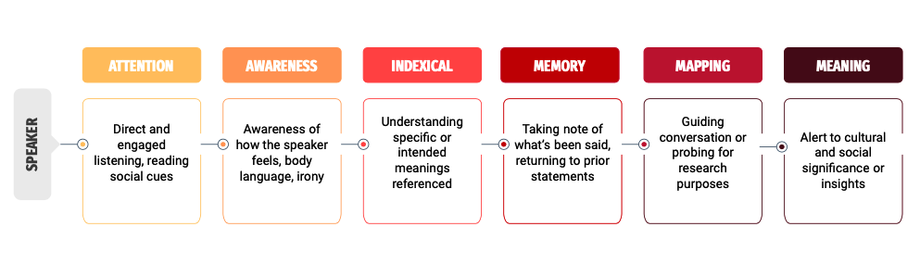

Der Kulturanthropologe Michael Powell betont in seinem Essay „The Sound of Friction“, dass „Zuhören“ eine äußerst effektive Technik ist, um menschliche Erfahrungen und kulturelle Interaktionselemente zu verstehen. Seine Forschungsergebnisse liefern Unternehmen, die KI-Musikgenerierungsdienste entwickeln, folgende Erkenntnisse.

Erstens könnten interaktive Feedbackschleifen sinnvoll sein.Man könnte sich vorstellen, den iterativen Prozess ethnologischer Interviews zu adaptieren, indem die KI auf die grundlegende Texteingabe mit Folgefragen reagiert oder die erstellte Musik an die anfänglichen Reaktionen des Benutzers anpasst und so die Integration eines Systems in Betracht zieht, das die erstellte Musik verfeinert und anpasst.

Zweitens könnte man versuchen, den emotionalen Ton oder die Referenzen in der grundlegenden Texteingabe zu erkennen und sich mit kulturellen Texturen zu befassen, um personalisierte Ergebnisse zu liefern.

Drittens könnte man sich vorstellen, dass das KI-System, ähnlich wie ein Ethnologe, der im Laufe seiner Forschung immer tiefere Einblicke gewinnt, seine Kenntnisse über die Präferenzen der Benutzer und die kulturellen Nuancen erweitert, indem es das Konzept der Gesprächshistorie erweitert.

KIs wie Udio stellen einen wichtigen Fortschritt in Bezug auf die Zugänglichkeit der Musikproduktion dar. Sie fordern uns aber auch dazu auf, über die Natur von Kreativität und darüber nachzudenken, wie wir die subtile Verbindung zwischen Musik und menschlicher Erfahrung herstellen können. Dieser Dialog zwischen Technologie und Tradition, Innovation und Tiefe wird die zukünftige Entwicklung der Musik im digitalen Zeitalter bestimmen. Deshalb ist es wichtig, nicht nur die Art und Weise, wie Klänge erzeugt werden, sondern auch, wie Klänge in unserer Gesellschaft wahrgenommen und geschätzt werden. Dies könnte uns helfen, die Zeit zu verlangsamen, in der „menschliche Kreationen“ ein teures Label werden.

Referenzen

![[Kolumne zur Sensibilisierung für Menschen mit Behinderungen] Chat GPT, generativer AI Udio (Udio) erscheint! Musik in 30 Sekunden mit Text erstellen](https://cdn.durumis.com/image/8f6jgo6d-1hs91m6l8?width=88&height=88)